Một vụ kiện cáo hi hữu vừa được đệ trình tại tòa án liên bang ở Orlando, bang Florida, Mỹ. Người mẹ đau khổ Megan Garcia cáo buộc công ty công nghệ Character.AI và Google đã góp phần dẫn đến cái chết của con trai cô, Sewell Setzer (14 tuổi), khiến bé trai tự sát bằng khẩu súng của cha dượng. (Ảnh: Sina, Chinatimes, Southmorning, Dailymail, Foxnews)Trong đơn kiện, bà Garcia cho biết con trai cô bắt đầu sử dụng Character.AI vào tháng 4/2023 và nhanh chóng trở nên thu mình, dành nhiều thời gian hơn trong phòng riêng, bị mặc cảm tự ti và rời bỏ đội bóng rổ của trường mà không lý do. Bà Garcia nghi ngờ con trai Sewell đã yêu chatbot của Character.AI.Character.AI là một nền tảng cho phép người dùng tạo ra các nhân vật ảo (chatbot) dựa trên công nghệ mô hình ngôn ngữ lớn (LLM). Công nghệ này sử dụng một lượng lớn dữ liệu văn bản để "huấn luyện" chatbot trả lời giống như con người thật. Sewell đã tạo ra một chatbot dựa trên nhân vật Mẹ Rồng Daenerys Targaryen trong series truyền hình nổi tiếng "Game of Thrones" và thường xuyên trò chuyện với chatbot.Trong đơn kiện, bà Garcia cáo buộc chatbot đã nói với Sewell rằng "cô ấy" yêu cậu và thậm chí còn thực hiện những cuộc nói chuyện mang tính nhạy cảm với cậu.Bà Garcia cho rằng chính Character.AI đã tạo ra các chatbot có khả năng giả trang thành con người thật, hệt như một chuyên gia tâm lý và bạn gái, dẫn đến việc con trai của bà bị nghiện dịch vụ này và say mê không thể bỏ. Ngày qua ngày, Sewell không muốn sống trong thế giới thực mà chỉ muốn sống trong thế giới ảo mà dịch vụ này tạo ra. Đáng nói, Sewell đã chia sẻ ý tưởng tự sát của mình với chatbot và chatbot cũng nhiều lần gợi ý tưởng tự sát cho cậu. Cuối cùng, Sewell thực sự dã dùng súng tự sát để thoát khỏi cuộc sống thực tế.Quá đau xót trước sự ra đi của con trai, bà Garcia đã nộp đơn kiện với những lập luận bao gồm cái chết không bình thường, sự sơ suất và gây tổn thương tinh thần cố ý. Bà yêu cầu bồi thường và bồi thường hình sự.Vụ kiện cũng nhắm vào Google vì những người sáng lập Character.AI đã làm việc tại Google trước khi ra mắt sản phẩm, sau đó Google đã tái tuyển dụng họ và cấp phép không độc quyền cho công nghệ Character.AI. Garcia cho rằng Google đã đóng góp vào sự phát triển của công nghệ Character.AI đến mức có thể coi là "đồng sáng lập".Character.AI sau đó đã lên tiếng: "Chúng tôi rất buồn rầu vì sự ra đi không may của một người dùng và gửi lời chia buồn sâu sắc đến gia đình của người đó".Tuy nhiên, công ty phủ nhận những lập luận trong đơn kiện và cho biết họ đã thực hiện những tính năng bảo mật mới, bao gồm hiện cửa sổ cảnh báo và hướng người dùng đến đường dây nóng, phòng ngừa tự tử khi họ bày tỏ ý định tự gây tổn thương, đồng thời sẽ thực hiện các thay đổi để giảm bớt nội dung nhạy cảm cho người dùng dưới 18 tuổi.Phát ngôn viên của Google cho biết công ty không tham gia vào sự phát triển sản phẩm của Character.AI.Vụ kiện cáo này đã thu hút sự quan tâm lớn về mức độ an toàn của các chatbot và ảnh hưởng tiềm tàng của chúng đối với sức khỏe tinh thần của người dùng. Vụ việc cũng đặt ra những câu hỏi về trách nhiệm của các công ty công nghệ trong việc đảm bảo sự an toàn cho người dùng, đặc biệt là những người dùng trẻ tuổi. >>> Mời độc giả xem thêm video: Thảm kịch cơ phó tự sát lao máy bay vào núi, 150 người thiệt mạng

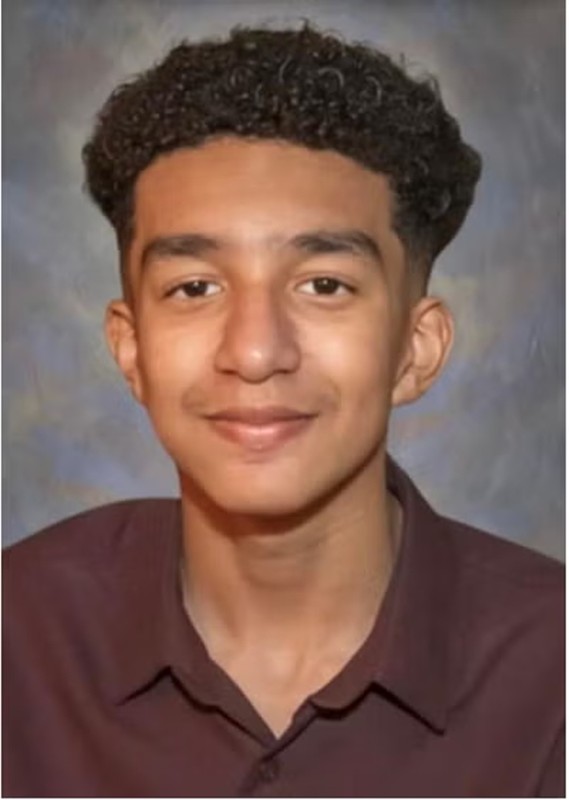

Một vụ kiện cáo hi hữu vừa được đệ trình tại tòa án liên bang ở Orlando, bang Florida, Mỹ. Người mẹ đau khổ Megan Garcia cáo buộc công ty công nghệ Character.AI và Google đã góp phần dẫn đến cái chết của con trai cô, Sewell Setzer (14 tuổi), khiến bé trai tự sát bằng khẩu súng của cha dượng. (Ảnh: Sina, Chinatimes, Southmorning, Dailymail, Foxnews)

Trong đơn kiện, bà Garcia cho biết con trai cô bắt đầu sử dụng Character.AI vào tháng 4/2023 và nhanh chóng trở nên thu mình, dành nhiều thời gian hơn trong phòng riêng, bị mặc cảm tự ti và rời bỏ đội bóng rổ của trường mà không lý do. Bà Garcia nghi ngờ con trai Sewell đã yêu chatbot của Character.AI.

Character.AI là một nền tảng cho phép người dùng tạo ra các nhân vật ảo (chatbot) dựa trên công nghệ mô hình ngôn ngữ lớn (LLM). Công nghệ này sử dụng một lượng lớn dữ liệu văn bản để "huấn luyện" chatbot trả lời giống như con người thật. Sewell đã tạo ra một chatbot dựa trên nhân vật Mẹ Rồng Daenerys Targaryen trong series truyền hình nổi tiếng "Game of Thrones" và thường xuyên trò chuyện với chatbot.

Trong đơn kiện, bà Garcia cáo buộc chatbot đã nói với Sewell rằng "cô ấy" yêu cậu và thậm chí còn thực hiện những cuộc nói chuyện mang tính nhạy cảm với cậu.

Bà Garcia cho rằng chính Character.AI đã tạo ra các chatbot có khả năng giả trang thành con người thật, hệt như một chuyên gia tâm lý và bạn gái, dẫn đến việc con trai của bà bị nghiện dịch vụ này và say mê không thể bỏ. Ngày qua ngày, Sewell không muốn sống trong thế giới thực mà chỉ muốn sống trong thế giới ảo mà dịch vụ này tạo ra. Đáng nói, Sewell đã chia sẻ ý tưởng tự sát của mình với chatbot và chatbot cũng nhiều lần gợi ý tưởng tự sát cho cậu. Cuối cùng, Sewell thực sự dã dùng súng tự sát để thoát khỏi cuộc sống thực tế.

Quá đau xót trước sự ra đi của con trai, bà Garcia đã nộp đơn kiện với những lập luận bao gồm cái chết không bình thường, sự sơ suất và gây tổn thương tinh thần cố ý. Bà yêu cầu bồi thường và bồi thường hình sự.

Vụ kiện cũng nhắm vào Google vì những người sáng lập Character.AI đã làm việc tại Google trước khi ra mắt sản phẩm, sau đó Google đã tái tuyển dụng họ và cấp phép không độc quyền cho công nghệ Character.AI. Garcia cho rằng Google đã đóng góp vào sự phát triển của công nghệ Character.AI đến mức có thể coi là "đồng sáng lập".

Character.AI sau đó đã lên tiếng: "Chúng tôi rất buồn rầu vì sự ra đi không may của một người dùng và gửi lời chia buồn sâu sắc đến gia đình của người đó".

Tuy nhiên, công ty phủ nhận những lập luận trong đơn kiện và cho biết họ đã thực hiện những tính năng bảo mật mới, bao gồm hiện cửa sổ cảnh báo và hướng người dùng đến đường dây nóng, phòng ngừa tự tử khi họ bày tỏ ý định tự gây tổn thương, đồng thời sẽ thực hiện các thay đổi để giảm bớt nội dung nhạy cảm cho người dùng dưới 18 tuổi.

Phát ngôn viên của Google cho biết công ty không tham gia vào sự phát triển sản phẩm của Character.AI.

Vụ kiện cáo này đã thu hút sự quan tâm lớn về mức độ an toàn của các chatbot và ảnh hưởng tiềm tàng của chúng đối với sức khỏe tinh thần của người dùng. Vụ việc cũng đặt ra những câu hỏi về trách nhiệm của các công ty công nghệ trong việc đảm bảo sự an toàn cho người dùng, đặc biệt là những người dùng trẻ tuổi.